Chào toàn thể anh em trong diễn đàn,

Hôm nay em xin phép được mở một chủ đề có lẽ hơi nặng nề, nhưng lại là vấn đề sống còn mà tất cả chúng ta sẽ phải đối mặt trong tương lai rất gần. Chuyện bắt nguồn từ việc em đọc cuốn sách "Không Ai Cản Được AI" của tác giả Huy Pencil, và có một chương trong đó phân tích về đạo đức của xe tự lái Tesla khiến em thực sự bị ám ảnh.

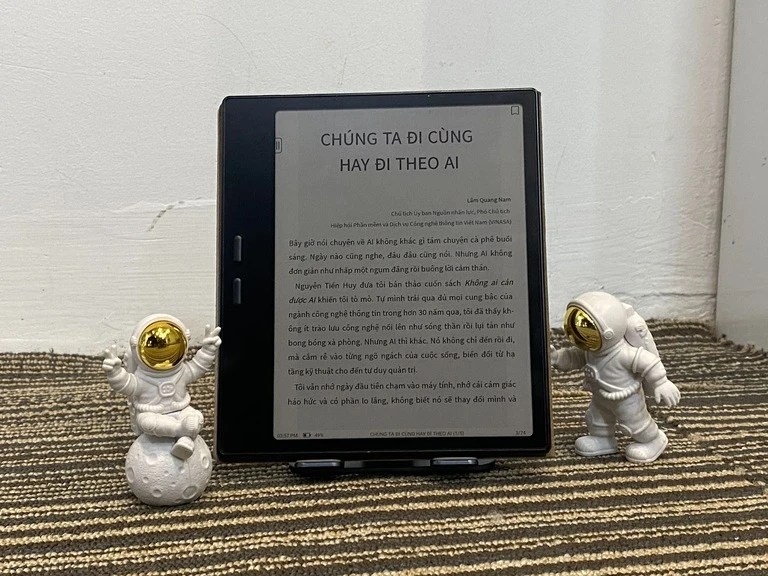

Cuốn sách “Không ai cản được AI” trên máy đọc sách

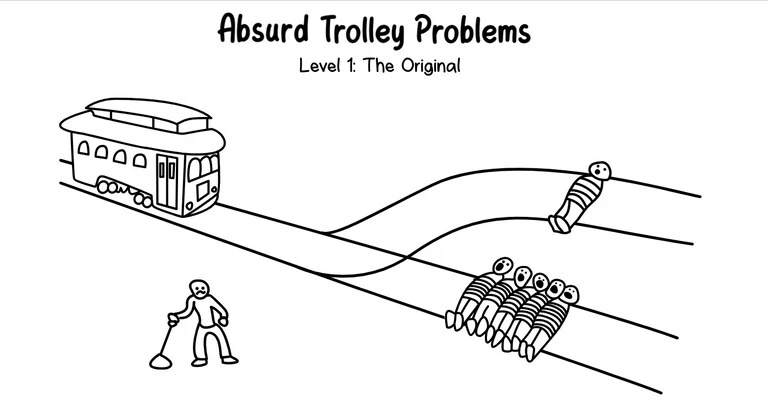

Chúng ta đều biết "Bài toán xe đẩy" (Trolley Problem) kinh điển trong triết học: Bạn có kéo một cái cần gạt để chuyển hướng một chiếc xe đẩy, hy sinh 1 người để cứu 5 người không? Đó từng là một bài tập tư duy thuần túy. Nhưng bây giờ, với sự ra đời của xe tự lái, bài toán đó không còn nằm trên giấy nữa. Nó đang được các kỹ sư công nghệ biến thành những dòng code lạnh lùng và chạy trên đường phố mỗi ngày.

Bài toán xe đẩy" (Trolley Problem)

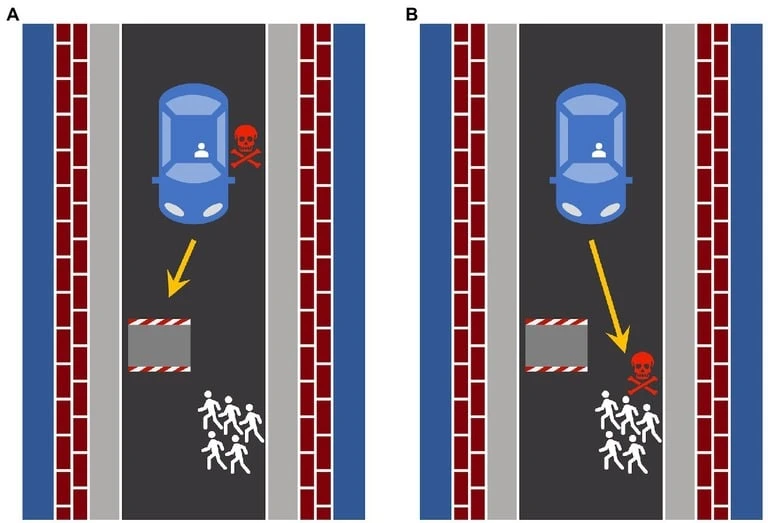

Hãy hình dung một kịch bản rất thực tế mà cuốn sách đã mô tả: Bạn đang ngồi thảnh thơi trong chiếc xe tự lái của mình. Đột nhiên, một nhóm 5 đứa trẻ lao ra đường. Chiếc xe chỉ có vài mili giây để xử lý và nó nhận ra rằng va chạm là không thể tránh khỏi. Thuật toán của nó chỉ có hai lựa chọn khả thi:

- Lựa chọn A: Giữ nguyên làn đường, chấp nhận va chạm với 5 đứa trẻ. Hậu quả: 5 người có nguy cơ thương vong, nhưng bạn, chủ nhân của chiếc xe, được an toàn tuyệt đối.

- Lựa chọn B: Đánh lái đột ngột, lao xe vào bức tường bê tông bên đường. Hậu quả: 5 đứa trẻ được cứu, nhưng bạn, người ngồi trong xe, gần như chắc chắn sẽ chịu thương vong nghiêm trọng.

Một con người trong tình huống đó sẽ phản xạ theo bản năng. Nhưng một cỗ máy thì khác. Nó sẽ quyết định dựa trên một hệ thống quy tắc đạo đức đã được lập trình sẵn. Và đây là lúc sự thật "lạnh gáy" xuất hiện: Ai là người đã viết ra những quy tắc đó?

Khi A.I cầm lái

Cuốn sách này đã mổ xẻ rất sâu về sự mơ hồ của trách nhiệm pháp lý trong kỷ nguyên AI (cụ thể là trang 83-85), một mớ bòng bong không có lời giải:

- Nhà sản xuất (Tesla)? Họ sẽ nói rằng công nghệ chỉ là "hỗ trợ lái" và người dùng phải luôn giám sát. Nhưng chính cách họ marketing sản phẩm ("Full Self-Driving") lại gieo vào đầu người dùng một sự tự tin thái quá. Liệu họ có đang cố tình lấp liếm rủi ro để bán được hàng?

- Người lập trình? Những kỹ sư viết ra thuật toán đó có phải chịu trách nhiệm không? Hay họ chỉ đơn giản là những người làm công ăn lương, tuân theo chỉ đạo của cấp trên? Hệ giá trị đạo đức cá nhân của một kỹ sư có thể ảnh hưởng đến mạng sống của hàng triệu người.

- Người chủ xe (chính là chúng ta)? Khi chúng ta bấm nút "Đồng ý với điều khoản sử dụng" mà không đọc, có phải chúng ta đã ngầm chấp nhận mọi rủi ro, kể cả việc thuật toán được lập trình để "hy sinh" chúng ta trong một số trường hợp nhất định?

- Chính AI? Hiện tại, AI không phải là một thực thể pháp lý. Nhưng trong tương lai, khi AI trở nên "tự nhận thức" hơn, liệu chúng ta có phải tạo ra một khung pháp lý mới cho "robot" không?

Hồi nhỏ, em rất mê đọc truyện của Isaac Asimov và luôn tin rằng "Ba điều luật Robot" là kim chỉ nam cho một tương lai hài hòa. Nhưng cuốn sách này đã chỉ ra rằng, ngoài đời thực, những điều luật đó đã hoàn toàn sụp đổ. Điều luật thứ nhất - "Robot không được làm tổn hại đến con người" - trở thành một nghịch lý khi mọi lựa chọn của AI đều dẫn đến việc có người bị tổn hại. Nó không còn là "làm hại" hay "không làm hại", mà là chọn "làm hại ai".

A.I và sự thay đổi toàn cầu

Đọc xong những phân tích này, em thực sự thấy bối rối và có phần lo sợ. Em xin phép nêu ra vài câu hỏi để các bác cùng vào mổ xẻ, vì nó ảnh hưởng đến tất cả chúng ta:

- Nếu các bác là người lập trình cho chiếc xe đó, các bác sẽ viết dòng code quyết định như thế nào? Cứu 1 người (chủ xe) hay cứu 5 người?

- Liệu các nhà sản xuất có nên công khai minh bạch thuật toán đạo đức của họ không? Ví dụ: "Xe của chúng tôi được lập trình theo triết lý Vị lợi - tối thiểu hóa thiệt hại nhân mạng".

- Có nên tồn tại một "công tắc đạo đức" trong xe, cho phép chủ xe tự chọn hệ giá trị cho mình không? (Ví dụ: Ưu tiên bảo vệ người trong xe / Ưu tiên bảo vệ người đi đường). Và nếu có, liệu nó có hợp pháp?

- Phải chăng đây là cái giá không thể tránh khỏi cho sự tiến bộ công nghệ?

Rất mong được lắng nghe những góc nhìn đa chiều của anh em. Xin cảm ơn.

"Bác nào muốn đọc sâu hơn về các case study tai nạn của Tesla và phân tích pháp lý, đạo đức của nó thì tìm đọc cuốn 'Không Ai Cản Được AI' của Huy Pencil nhé. Em cũng đọc từ sách này ra để viết bài này thôi. Em mua bản ebook trên Savi, vì nó là app duy nhất hiện nay chuyên cho máy đọc sách, format cực chuẩn, đọc mấy đoạn phân tích dài, hack não này trên màn hình e-ink không bị mỏi mắt, lại tiện để highlight và ghi chú lại mấy ý hay để nghiền ngẫm. Chứ đọc trên điện thoại chắc nổ não mất."

Bản ebook 'Không Ai Cản Được AI' của tác giả Huy Penci trên app Savi Nguồn:tinhte.vn/thread/xe-tu-lai-cua-tesla-duoc-lap-trinh-de-g-i-e-t-ai-trong-truong-hop-tai-nan-khong-the-tranh-khoi.4042040/